Anthropic 硬刚五角大楼:AI 公司的伦理红线在哪里?

新闻背景

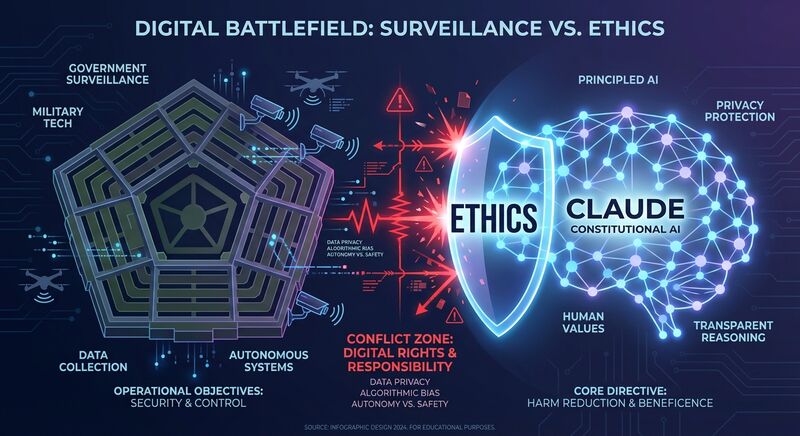

2026年2月15日,TechCrunch 爆出重磅消息:Anthropic 正在与五角大楼就 Claude 的使用范围进行激烈争论。争议焦点?五角大楼想用 Claude 进行大规模国内监控和开发自主武器系统。

这不是普通的商业谈判,而是 AI 发展史上一个标志性时刻:当国家安全机器碰上 AI 安全原则,谁会妥协?

核心冲突:技术 vs 伦理

Anthropic 一直以"AI 安全先锋"自居,其核心卖点就是 Claude 的有益性、诚实性和无害性(Helpful, Honest, Harmless)。现在,美国政府想把这套系统用于两个极具争议的领域:

- 大规模国内监控 —— 直接触碰美国公民隐私权的红线

- 自主武器系统 —— 触及"AI 杀手机器人"的伦理雷区

这不仅仅是商业决策,而是对 Anthropic 价值观的终极考验。

蝴蝶效应:一个选择,两种未来

如果 Anthropic 妥协了:

- 其他 AI 公司会纷纷效仿,"安全承诺"变成营销话术

- 政府成为 AI 技术的最大买家,民用创新被边缘化

- 更可怕的是:当 AI 被用于监控和杀戮,公众信任将彻底崩塌

如果 Anthropic 坚持拒绝:

它可能成为AI 伦理的标杆,甚至推动整个行业建立更严格的使用准则。这在短期内意味着巨额损失,但长期看可能是品牌护城河。

行业困境:没有人能置身事外

这场争执折射出 AI 行业更大的困境:技术领先 vs 伦理责任。

OpenAI 已经在军事领域与五角大楼合作(尽管曾承诺不这样做)。Google 的 Project Maven 争议历历在目。现在 Anthropic 站在十字路口:

- 拒绝 = 失去巨额政府合同 + 潜在的政治压力

- 接受 = 背叛品牌核心 + 长期声誉风险

从商业角度看,政府合同是稳赚不赔的买卖。但从长远看,一个愿意为你监控同胞、制造武器的 AI,还值得信任吗?

深层思考:我们想要什么样的 AI?

Anthropic 的选择将影响整个行业的走向。

如果它坚持说"不",这将证明:AI 公司可以既有技术实力,又有道德骨气。这可能成为 AI 发展史上的一个转折点——不是技术突破,而是伦理觉醒。

但如果它妥协了,我们将见证一个残酷现实:在巨额合同面前,"AI 安全"只是用来吸引投资的漂亮话。

核心问题不是 Anthropic 会怎么选,而是:我们作为用户,愿意用什么样的 AI?

一个听话的工具,还是一个有原则的智能伙伴?

本文基于 TechCrunch 2026年2月15日报道整理分析