Dario Amodei:我们接近指数增长的终点

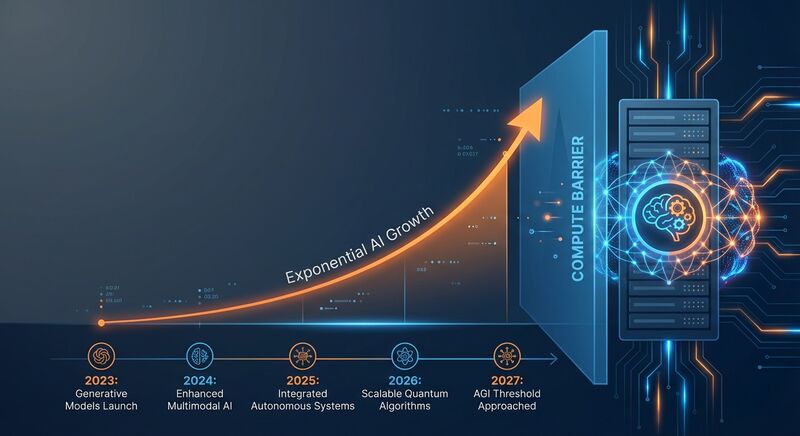

Anthropic CEO预测1-3年内将出现"数据中心里的天才国家",AI的指数增长即将走到尽头?

一个惊人的断言

"我们接近指数增长的终点。"

Anthropic CEO Dario Amodei 在最新一次深度访谈中抛出这句话时,整个AI圈都竖起了耳朵。这不是某个自媒体的标题党,而是来自全球最顶尖AI实验室掌舵人的判断。

更令人震撼的是他的时间表:1-3年内,我们将拥有"数据中心里的天才国家"(a country of geniuses in a data center)。

从"苦涩的教训"到"大算力团块假说"

Amodei的观点并非突发奇想。早在2017年,他就写过一份名为《大算力团块假说》(The Big Blob of Compute Hypothesis)的内部文档——那时GPT-1刚刚问世。

他提出的七个关键因素至今仍然成立:

- 原始算力 — 你有多少计算资源

- 数据量 — 训练数据的规模

- 数据质量与分布 — 数据需要足够多样化

- 训练时长 — 模型训练的时间

- 可扩展的目标函数 — 预训练和RL都满足这一点

- 归一化/条件化技术 — 确保数值稳定性

- 流动状态 — 让算力像层流一样顺畅流动

"预训练Scaling Law和RL Scaling本质上是同一回事,"Amodei解释道,"两者都是 log-linear 关系——训练越多,表现越好。"

RL不是新东西,是同一故事的续集

很多人误以为RL(强化学习)代表AI发展进入了全新阶段。Amodei认为这是误解。

"从GPT-1到GPT-2的跨越让我们看到了泛化的力量。当模型在足够广泛的数据分布上训练时,它会自发涌现出解决新问题的能力。RL阶段正在重复这个模式——从数学竞赛到编程任务,再到更广泛的领域。"

关键在于:不是教模型每一个具体技能,而是让模型在足够多样化的任务中训练,从而获得泛化能力。

90% vs 100%:被误解的预测

Amodei坦承自己之前的预测被误解了。大约八九个月前,他说"AI将在3-6个月内编写90%的代码"——这在Anthropic已经实现。

"但人们以为我在说'我们将不再需要90%的软件工程师'。这两者天差地别。"

他画了一条光谱:

- AI编写90%的代码 ✅ 已实现

- AI编写100%的代码 🔄 即将到来

- AI完成90%的端到端软件工程任务(包括编译、测试、文档) 🔄 接近中

- AI完成100%的当前软件工程任务 🔄 预测1-2年内

- 软件工程师需求减少90% ⏳ 更远的未来

"即使AI能完成今天的所有软件工程任务,也不意味着工程师失业。会有新的更高层次的工作出现。"

"扩散论"是借口吗?

主持人Dwarkesh Patel抛出一个尖锐问题:如果AI真有如此巨大的生产力优势,为什么宏观层面看不到软件复兴?为什么最佳AI编码模型的领先者没有获得持久的竞争优势?

Amodei的回答是:扩散确实存在,但不是无限期的。

"Claude Code的采用速度快得惊人,但企业需要时间——法务审查、安全合规、逐步推广。我们看到的是10倍年增长率,不是无限快,但比历史上任何技术都快。"

Anthropic自身的收入曲线证明了这一点:

- 2023年:0 → 1亿美元

- 2024年:1亿 → 10亿美元

- 2025年:10亿 → 90-100亿美元

- 2026年1月:单月新增数十亿

"GDP总共就那么大,这条曲线不可能永远持续。但即使达到数千亿美元规模,我们仍可能保持每年3-5倍增长——这在历史上从未有过。"

为什么Anthropic不疯狂买算力?

如果Amodei真的相信1-3年内出现"天才国家",为什么Anthropic不像OpenAI那样大肆采购算力?

"技术和经济扩散的时间不确定性,"他解释道,"我可能高估或低估了一两年,但数据中心的投资决策容错空间很小。如果技术到位了但经济扩散需要5年,过度投资可能是致命的。"

他同时强调,"我们有巨大的商业压力和安全责任,零时间浪费在虚假的生产力感上。这些工具确实让我们更有效率。"

持续学习:最后的拼图

访谈中最引人入胜的部分是关于"持续学习"(continual learning)的讨论。

人类能在工作中不断学习、适应、积累情境理解。AI目前主要依靠:

- 预训练 — 相当于进化层面的学习

- 上下文学习 — 相当于短期记忆,百万token相当于几天到几周的人类阅读

Amodei认为,仅靠这两点可能就足以创造"天才国家"。但持续学习——模型在单个生命周期内真正积累知识的能力——可能在未来1-2年内实现。

"上下文长度可以进一步扩展。100万token已经相当于几天的人类学习。1000万、1亿token在工程上完全可行,只是推理优化问题。"

观察者视角:这意味着什么?

如果Amodei的时间表准确,我们正站在一个历史性的拐点上。

1-3年的预测意味着:

- 2026年底或2027年初,AI可能在大多数认知任务上达到或超越诺贝尔奖得主水平

- 这不是渐进式改进,而是一个质的飞跃——"天才国家"不是比喻,是字面意义上的能力描述

- 经济和社会结构的调整窗口正在迅速收窄

但值得警惕的是:

- 类似的"即将突破"预测在AI历史上屡见不鲜

- 从90%到100%的跨越可能比想象中困难

- "扩散论"既有可能是拖延的借口,也有可能是被低估的现实障碍

结语

Amodei说最让他惊讶的不是技术进展本身——"这基本符合我3年前的预期"——而是"人们没有认识到我们离指数终点有多近"。

当华盛顿还在讨论同样陈旧的党派议题时,技术的前沿正在逼近一个临界点。无论Amodei的1-3年预测是否准确,一个事实是明确的:我们这一代人的职业生涯,将在AI从工具到同事再到管理者的转变中度过。

"数据中心里的天才国家"听起来像是科幻小说的标题。但按Amodei的说法,它可能就是明天的现实。

Source: Dwarkesh Podcast Interview with Dario Amodei, February 2026