Google Docs AI音频摘要:当文档开始说话,知识工作者的耳朵正在接管大脑

Google正在让你的文档学会说话——而且只说重点。

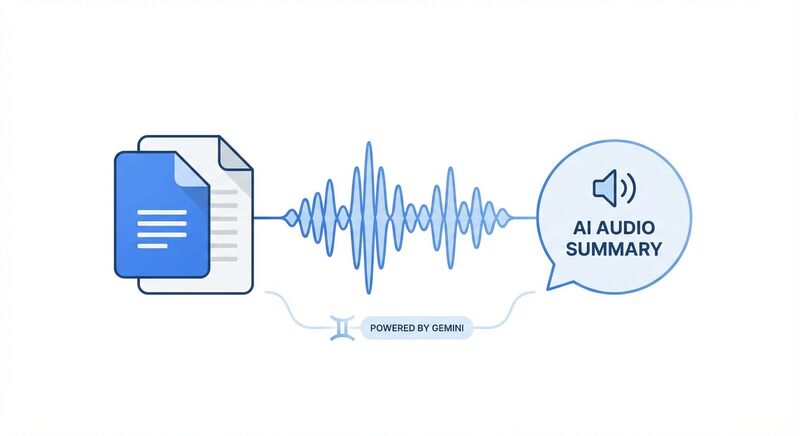

本周,Google宣布为Google Docs推出一项颇具野心的新功能:AI音频摘要(Audio Summaries)。 powered by Gemini,这个功能可以将你的长篇文档转化为一段流畅的语音摘要,让你在通勤、健身或做家务时"收听"那些原本需要正襟危坐才能读完的报告。

这不仅仅是一个"朗读功能"的简单升级。这是AI对知识消费方式的重新定义。

功能拆解:不是朗读,是理解后的重构

Google官方对这个功能的描述很克制:Gemini会分析文档内容,生成一个凝练的概述,然后以自然语音的形式呈现。用户可以在Docs的Tools菜单中找到它,目前开始向部分商业用户和Google One AI订阅者推送。

但背后的技术野心不容小觑。

传统的文本转语音(TTS)只是机械地将文字转为声音,而Gemini的音频摘要涉及三个层次的AI能力:

- 语义理解:识别文档的核心论点、关键数据和结论

- 信息压缩:在保持逻辑连贯的前提下大幅精简内容

- 语音生成:以自然、富有节奏感的方式"讲述"这些要点

这不是"读文档",这是"让AI替你读完然后讲给你听"。

为什么是现在?听觉注意力经济的崛起

Google选择在这个时间点推出音频摘要,绝非偶然。

知识工作者的注意力早已碎片化。 根据多项研究,普通职场人每天需要处理的信息量相当于174份报纸,而人们的阅读时间和深度专注能力却在持续下降。与此同时,播客、有声书、语音消息的爆发证明了一件事:人们的耳朵比眼睛有更长的"续航时间"。

音频摘要精准击中了这个痛点:

- 多任务场景:你可以一边跑步一边"阅读"那份50页的行业报告

- 降低认知门槛:听觉处理对某些人来说比视觉阅读更轻松

- 突破场景限制:开车、做饭、排队——这些原本无法阅读的时间段被激活了

Google不是在卖一个功能,它在争夺你的听觉注意力。

竞争格局:文档战争的下一个战场

这个功能看似只是Docs的一个小更新,实则可能是办公软件竞争格局的转折点。

Microsoft Copilot已经在文本生成领域建立优势,而Google选择了一条差异化路径:不是比谁写得快,而是比谁让用户的消费体验更好。音频摘要是一种典型的"体验型功能"——一旦习惯,就很难回到过去。

更深远的影响在于多模态AI的竞争。Gemini从一开始就被设计成原生多模态模型,能够无缝处理文本、图像、音频和视频。Docs的音频摘要功能是这种能力的第一次大规模产品化落地。相比之下,OpenAI的GPT-4o虽然也有语音能力,但在办公场景的深度整合上明显落后。

这场战争正在从"谁能生成更好的内容"转向"谁能提供更好的人机交互体验"。

隐忧与质疑:信息茧房的听觉版本?

每一项便利背后都有代价,音频摘要也不例外。

第一,摘要即选择,选择即偏见。 Gemini决定什么是"重点"的过程并不透明。当AI替你筛选信息时,它也在替你决定什么是重要的。长期依赖音频摘要,可能导致用户对文档的理解停留在"二手信息"层面,失去自主判断和深度思考的机会。

第二,听觉的被动性。 阅读是一种主动认知行为——你可以暂停、回退、跳过、批注。而听觉更像是一种被动接收,信息的节奏由AI控制而非用户。这种被动性可能降低信息的留存率和批判性思考。

第三,方言与口音的隐形歧视。 目前的AI语音技术虽然已经相当自然,但主要基于标准口音训练。非母语者或口音较重的用户,可能在"收听"文档时面临额外的认知负担——这是一个鲜少被讨论但真实存在的公平性问题。

未来图景:从"写文档"到"设计文档体验"

如果音频摘要成为常态,文档本身的形态可能随之改变。

想象一下:未来的报告作者需要考虑的不只是"读者",还有"听众"。文档结构可能需要为音频消费重新设计——更清晰的层级、更适合口语化的表达、甚至专门为音频版撰写的开场白和结尾总结。

更进一步,音频摘要可能进化为交互式语音问答:听完摘要后,你可以直接语音提问"第三点的数据来源是什么?",AI会立即定位并朗读相关段落。

Google Docs的这次更新,可能只是这场变革的序章。

写在最后

AI音频摘要不是一个革命性的技术突破,但它是一个极具洞察力的产品决策。它承认了一个现实:在这个信息过载的时代,帮助人们更好地消费内容,比帮助他们更快地生产内容更有价值。

Google正在用Gemini重新定义"阅读"。下一次当你打开一份长篇文档时,也许你的第一反应不是"开始阅读",而是"点击收听"。

知识的载体在变,但人类对高效获取信息的渴望从未改变。

图片来源:由AI生成

参考来源:The Verge, Google Workspace Blog