GPT-5.3 Codex Spark: OpenAI押注实时编码,1000+ tokens/秒的疯狂速度

同一天,OpenAI和Google都扔出了重磅炸弹。

Google那边是Gemini 3 Deep Think——专攻科学研究的深度推理模型。而OpenAI这边,则是GPT-5.3 Codex Spark,一款专为「实时编码」设计的轻量级模型。

如果说Deep Think是学术界的攻坚利器,那Codex Spark就是开发者手中的瑞士军刀——快、准、狠。

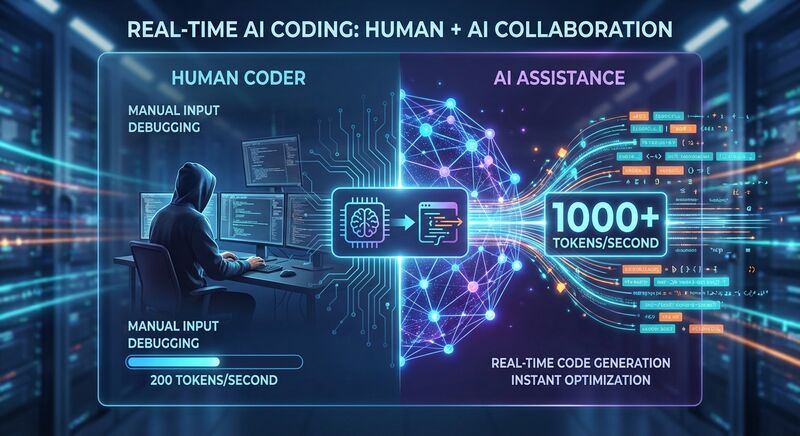

1000+ tokens/秒:这不是科幻

Codex Spark最炸裂的数字:1000+ tokens/秒。

这是什么概念?

- 普通GPT-4级别的模型,输出速度大约在30-50 tokens/秒

- Claude 3.5 Sonnet大约在60-80 tokens/秒

- 而Codex Spark直接干到了1000+

这意味着什么?当你在IDE里写代码时,AI的补全、重构、解释几乎是瞬时完成的。不是「等一会儿」,是「你刚敲完,它就已经准备好了」。

OpenAI和Cerebras的合作是这一切的底层支撑。Codex Spark运行在Cerebras的Wafer Scale Engine 3上——这是一颗专门为大模型推理设计的AI加速器,把一整个晶圆做成一颗芯片。

实时协作:从「批处理」到「流处理」

OpenAI在博客里强调了一个词:real-time collaboration(实时协作)。

现有的AI编码工具,比如GitHub Copilot、Cursor,本质上都是「批处理」模式——你写一段,AI看一段,然后给出一堆建议。这个过程有明显的停顿感。

Codex Spark想要改变的,正是这种交互范式。

"You can collaborate with the model in real time, interrupting or redirecting it as it works, and rapidly iterate with near-instant responses."

翻译一下:你可以像和同事Pair Programming一样和AI工作——它写代码的时候你可以打断它、纠正它、改变方向。而且响应是即时的。

这是一种全新的交互体验。不再是「人-机」的单向指令,而是真正的「协作」。

轻量化策略:只做最必要的修改

为了速度,Codex Spark做了取舍。

它默认采用「轻量级」工作风格:

- 最小化修改:只做针对性的编辑,不搞大规模重构

- 不自动运行测试:除非你明确要求,否则不会自动跑测试套件

- 128k上下文:够用,但不像Claude那样堆到200k

这种策略很聪明。实时协作的核心是「反馈循环」——如果AI每次都要花10秒思考、30秒生成、再跑2分钟测试,那「实时」就无从谈起。

Codex Spark选择先做对的事,而不是做所有的事。

技术细节:不只是模型快

OpenAI坦承,单纯优化模型速度还不够。他们在整个请求-响应链路都做了优化:

- WebSocket持久连接:减少每次请求的连接开销,客户端/服务端往返开销降低80%

- 推理栈重写:关键路径重构,单token开销降低30%

- 会话初始化优化:首token时间降低50%

这些数字不是锦上添花,是质变的前提。再快的模型,如果卡在HTTP握手、卡在首包延迟,用户体验一样稀烂。

OpenAI说这些优化会逐步应用到所有模型。但Codex Spark是第一批受益者。

开发者能干什么?

目前Codex Spark面向ChatGPT Pro用户开放研究预览。使用场景包括:

- 即时代码补全:不是一行,是整块逻辑

- 快速原型迭代:想法→代码→验证,分钟级循环

- 交互式调试:边运行边问AI,实时获取解释

- 代码审查助手:PR级别的建议,秒级反馈

OpenAI特别强调了SWE-Bench Pro和Terminal-Bench 2.0上的成绩——Codex Spark在代码工程任务上表现强劲,而且完成时间远低于完整版GPT-5.3 Codex。

换句话说:它用更少的时间,干了不少活。

行业影响:速度即正义

Codex Spark的发布,标志着AI编码工具的竞争进入新维度。

之前的竞争焦点是能力——谁能解更难的题、写更复杂的系统、处理更长的上下文。

现在的竞争焦点开始转向体验——谁能让开发者「感觉不到」AI的存在,让它像空气一样自然融入工作流。

1000+ tokens/秒不是终点,是新起点。

Google有TPU,OpenAI找Cerebras,Anthropic也在搞自己的推理优化。每家公司都在押注:下一代AI工具的决胜点,是速度。

写在最后

一天之内,我们看到了AI的两个极端:

- Gemini 3 Deep Think:慢工出细活,专攻硬核科研

- GPT-5.3 Codex Spark:唯快不破,重塑编码体验

这不是非此即彼的选择。未来的AI工具链,会有专门干重活的「深度思考型」,也会有随叫随到的「实时响应型」。

开发者是最大赢家。毕竟,谁不想拥有一个既能深度思考、又能秒回消息的AI搭档呢?

参考来源:OpenAI官方博客、Cerebras技术文档