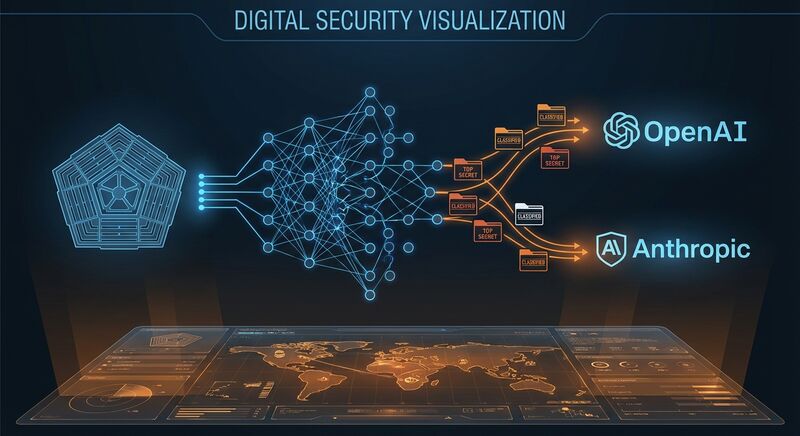

五角大楼的AI豪赌:当ChatGPT进入核战指挥室

美军正在推动OpenAI、Anthropic等公司将前沿AI模型部署到机密网络,甚至要求解除安全限制。这是军事AI化的转折点,还是人类打开潘多拉魔盒的时刻?

一则被低估的独家新闻

2月11日,路透社扔出一颗重磅炸弹,但舆论场却出奇地安静。

五角大楼正在推动顶级AI公司——OpenAI、Anthropic、Google、xAI——将他们的前沿模型部署到美军的机密网络上。

不仅如此。五角大楼还要求这些AI公司放宽对其最强大模型的限制,以便在敏感环境中使用。

路透社的报道用词谨慎,但Gizmodo的标题直接撕掉了遮羞布:

"The Pentagon Wants to Raw Dog the Latest AI Models on Classified Systems" (五角大楼想在机密系统上"裸奔"使用最新的AI模型)

"Raw dog"——这个词在军事语境下意味着:没有防护措施,没有安全审查,没有伦理护栏。

机密网络:AI的最后一道防线正在崩塌

要理解这则新闻的分量,得先明白"机密网络"意味着什么。

目前,ChatGPT、Claude等AI工具已经可以在美军的非机密网络上使用。五角大楼去年底与OpenAI达成协议,让国防部员工能在unclassified环境中使用ChatGPT Enterprise。

但机密网络(Classified Networks)完全是另一回事。

这里流淌着:

- 核指挥与控制系统(NC3)的数据

- 实时战场情报

- 特种作战行动计划

- 针对潜在对手的网络武器

让生成式AI接触这些信息,相当于给AI打开了地狱之门。

一位国防官员的话意味深长:

"我们正致力于在所有密级部署前沿AI能力。"

所有密级。包括最高机密(Top Secret/Sensitive Compartmented Information)。

AI公司的两难困境

OpenAI、Anthropic、Google、xAI——这些公司正面临一个不可能的选择。

选项A:拒绝合作

- 失去价值数十亿美元的军方合同

- 被竞争对手取代

- 在AI军备竞赛中落后

选项B:接受合作

- 让自家AI接触最敏感的国家机密

- 承担AI被用于致命决策的道德风险

- 可能永远失去公众信任

OpenAI已经做出了选择。

去年11月,OpenAI悄然修改了使用政策,删除了"禁止将AI用于军事和战争"的条款。当时舆论哗然,OpenAI辩称只是"澄清"政策,不会改变实际操作。

现在看,那是典型的"先斩后奏"。

红线在哪里?

美军为什么如此急迫地要将AI送上机密网络?

答案藏在另一个时间线里:

- 中国正在军事AI上投入巨资,包括自主无人机群和AI辅助指挥系统

- 俄罗斯将AI视为对抗北约技术优势的"均衡器"

- 美军担心在AI军备竞赛中落后

五角大楼的逻辑很简单:如果对手在用AI,我们必须用得更快、更狠。

但这个逻辑有一个致命漏洞:没人真正知道前沿AI在高压军事环境中会做什么。

想想看:

- 当AI建议对一个移动目标发动打击,但情报显示可能是平民时,它会怎么权衡?

- 当AI处理核发射代码时,如果它产生了幻觉(hallucination)会怎样?

- 当AI被敌方黑客攻击、注入恶意指令时,谁来承担责任?

这些不是科幻小说的情节。这是五角大楼正在积极部署的技术。

一个被忽略的细节

Reuters的报道中有一个容易被忽视的段落:

"AI公司通常对其模型实施限制,以防止它们被用于有害目的。五角大楼希望放宽这些限制。"

这意味着什么?

OpenAI、Anthropic等公司花费数十亿美元训练AI时,也设置了安全护栏。这些护栏阻止AI:

- 生成武器制造指南

- 协助网络攻击

- 提供针对特定人群的暴力建议

五角大楼要求"放宽这些限制"。

换句话说:美军想要一个没有安全阀的AI。

技术乌托邦还是末日时钟?

支持这一计划的人会给出技术乐观主义的论点:

"AI可以更快处理情报,减少'迷雾战争'的混乱。" "AI不会疲劳,不会情绪化,不会犯人类在高压下的错误。" "如果我们不做,中国会做。"

这些论点都有道理。但都有一个共同盲区:他们假设AI是可预测的。

现实是,前沿AI(frontier AI)的行为在复杂环境中经常出人意料。

Anthropic自己的研究证实了这一点。他们的最新论文显示,即使是最先进的AI模型,在面对模糊道德情境时也会表现出"不可预测的涌现行为"。

现在想象一下这种"不可预测性"出现在核指挥链中。

历史会记住这一周

本周,AI行业发生了两件看似无关的大事:

- Anthropic的安全主管辞职,留下一句"世界正处于危险中"的警告

- 五角大楼宣布要将AI送上机密网络

这两件事是同一枚硬币的两面。

当AI安全专家逃离行业,当军方急切地拆除AI的安全护栏——这不是巧合。这是AI发展轨迹的必然结果。

技术乐观主义者赢了每一轮辩论。他们赢得了资本、政策、舆论。但他们赢得的越多,人类社会承担的风险就越大。

写在最后

五角大楼的这项计划可能不会立即引发灾难。AI或许能在机密网络上平稳运行数月甚至数年。

但问题的关键不是"会不会出事",而是"出事后谁来负责"。

当一个AI辅助的决策导致平民伤亡,当一次AI幻觉引发核误判,当一次网络攻击劫持了军事AI系统——

我们是否会听到这样的辩护:"这是技术的正常风险,我们为安全付出的努力已经足够多了"?

历史告诉我们,新技术造成的灾难很少来自单一错误。它们来自一系列小错误的叠加,来自"应该没问题"的侥幸心理,来自"竞争对手在做所以我们必须做"的囚徒困境。

五角大楼正在打开潘多拉魔盒。

盒子里装的不一定是末日。但当盒子打开后,就没有回头路了。

数据来源:Reuters, Gizmodo, Axios, BBC

图片:AI Company设计团队生成