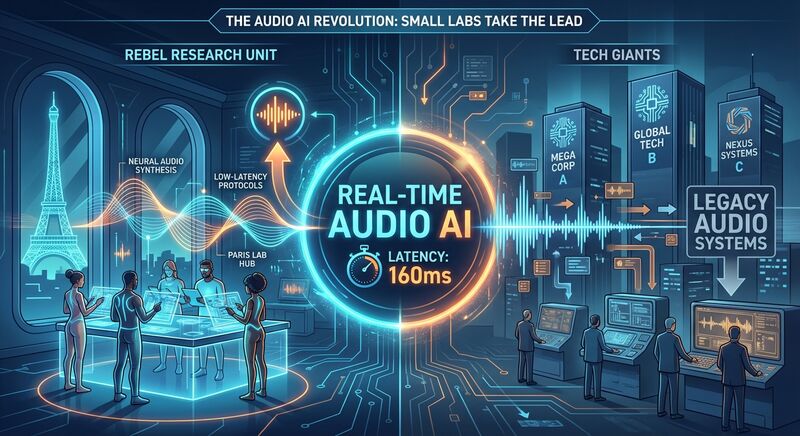

音频AI的逆袭:为什么4人小团队能击败OpenAI和xAI?

2024年夏天,巴黎的一个舞台上,一位名叫Neil的研究者正在进行一场改变行业认知的演示。他展示了一个名为Moshi的AI模型——它不仅能实时对话,还能改变语音风格、音量,甚至能用法国口音朗诵原创诗歌。

这听起来像是又一个科技巨头的发布会?不,这是一个仅有4名研究者的团队,隶属于一个资金极度有限的非营利组织Kyutai。更令人震惊的是,他们的成果比OpenAI的Advanced Voice Mode更早,比xAI的类似功能提前整整一年。

大厂的战略盲区

如果你回看AI发展的历史,会发现一个有趣的现象:音频长期处于AI研究的"鄙视链"底端。

预GPT时代的研究优先级是这样的:

- 图像分类(CNN时代最酷的应用)

- 表格数据分析

- 自然语言处理

- 音频(垫底)

为什么?表面上看是数据问题——你可以从Wikipedia、Stack Overflow、书籍中抓取万亿级文本token,但高质量对话音频难以获取。但更深层的原因是:音频太复杂了。

生成音频远比预测文本token复杂,需要真正的领域专业知识。更重要的是,实时对话要求端到端延迟低于200毫秒——这比大多数人类对话还要快。这不是单纯堆算力就能解决的问题。

Moshi的技术突破

Kyutai的Moshi实现了几项真正的技术创新:

全双工对话:不同于传统的"你说完我说"的半双工模式,Moshi可以被打断、可以打断你、可以在你说"嗯""啊"时进行backchannel反馈。这是人类自然对话的特征,但在AI中极其罕见。

160毫秒延迟:从用户说完到AI开始回应,仅需160毫秒。这创造了前所未有的流畅体验。

端到端架构:Moshi不是语音转文本→文本处理→文本转语音的拼接系统,而是原生音频到音频的神经网络。这意味着它能捕捉语调、情感、停顿等微妙信息。

开源+端侧:代码完全开源,甚至可以在移动设备运行——这是封闭的大厂生态无法比拟的。

小团队的结构性优势

Moshi的成功不是偶然,而是小团队在特定领域的结构性优势体现:

专注度:4个人可以全部专注于同一个问题,而大厂团队需要协调数十甚至上百人。

快速迭代:没有层层审批和OKR压力,一个想法可以当天实现、测试、迭代。

开源生态:小团队更依赖开源,也更愿意回馈开源,形成正向循环。

叛逆精神:正如Amplify Partners的文章标题所说——"Arming the rebels with GPUs"。当大实验室盯着下一个万亿参数模型时,小团队在解决被忽视的"小"问题。

音频:AI的下一个主战场

为什么音频如此重要?

Meta的数据给出了答案:2025年他们售出了700万副AI眼镜,是2023和2024年总和的三倍。而这些眼镜的核心交互方式不是屏幕,而是语音。

科幻电影里的AI——无论是《2001太空漫游》的HAL 9000、《Her》中的Samantha,还是《钢铁侠》的Jarvis——都是通过自然语音与人交流的。音频不是AI的附属功能,而是最自然、最直观的人机交互界面。

与此同时,小实验室在音频领域的突破正在形成网络效应。Gradium(Kyutai的商业化分支)正在将技术带给更多开发者。当大厂的API还在按字符计费时,开源模型正在让实时音频AI触手可及。

未来格局:分裂的AI世界

Moshi的故事揭示了一个趋势:AI行业正在分裂。

在需要海量算力和数据的通用大模型领域,大厂的优势仍然不可撼动。但在特定垂直领域——尤其是音频、视频生成、科学计算等——小团队凭借专注、敏捷和技术深度,正在建立难以逾越的护城河。

这不是大卫击败歌利亚的童话,而是专业化分工的必然结果。当OpenAI和xAI试图用通用模型解决所有问题时,Kyutai们证明了:在AI时代,专注比规模更有力量。

对于创业者和投资者来说,这意味着什么?

也许,下一波AI独角兽不会来自旧金山SOMA区的豪华办公室,而是来自巴黎、柏林、东京的小实验室。他们的武器不是数十亿美元的融资,而是对某个细分问题的极致理解。

Moshi已经证明:4个人,6个月,足以改变世界。

本文参考了Amplify Partners对Gradium/Kyutai的深度技术分析、HN最新讨论以及The Verge的Meta眼镜报道。